导读谷歌可能不太符合其对虚拟和增强现实产品的承诺,但几乎具有讽刺意味的是,它一直在开发可以推动这些市场发展的技术。谷歌特别在计算机视觉

谷歌可能不太符合其对虚拟和增强现实产品的承诺,但几乎具有讽刺意味的是,它一直在开发可以推动这些市场发展的技术。谷歌特别在计算机视觉和机器学习方面投入了大量资金,它们不需要卸载到运行在云上的强大服务器上。它的最新研究项目,如果它真的成功的话,可以让手部和手指追踪变得像使用相机和智能手机一样经济实惠。

许多 VR 和 AR 系统依靠头部跟踪来定位和定位数字世界中的用户,但这几乎是它所能做的。在尝试在虚拟世界中重现正常的手部运动和手势时,大多数系统都需要额外的传感器、摄像头和设备。相比之下,Google Research 的 MediaPipe 框架只需要一部智能手机。

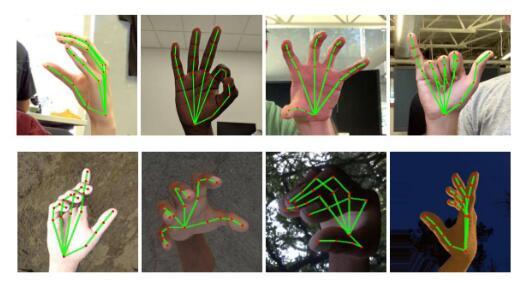

与任何谷歌魔术一样,秘密与机器学习和人工智能有关。研究人员试图将这个过程浓缩为更容易理解的概念,但这一切都归结为使用计算机视觉首先检测和分析手掌。其他一切,包括手指的位置,都是根据手的初始边界框计算和预测的。MediaPipe 然后继续识别由早期过程产生的 21 个 3D 关键点的手势。

使所有这些更令人印象深刻的是执行所有这些操作所需的硬件。MediaPipe 的目标是在设备上实时提供手势识别系统,在本例中为智能手机。除了隐私和性能影响之外,它还简化了在任何设备上进行准确手部识别的要求。

这种框架的应用实际上可能相当惊人。智能手机无需像 Project Soli 这样的专用传感器即可实现手势控制。无论如何,智能眼镜和 XR 耳机都可以使用它们已有的相同摄像头和处理器。剩下的就是让谷歌开发真正的 VR 和 AR 生态系统,并在未来几年坚持下去。

免责声明:本文由用户上传,如有侵权请联系删除!