Google I / O:从“人工智能第一”到AI为每个人工作

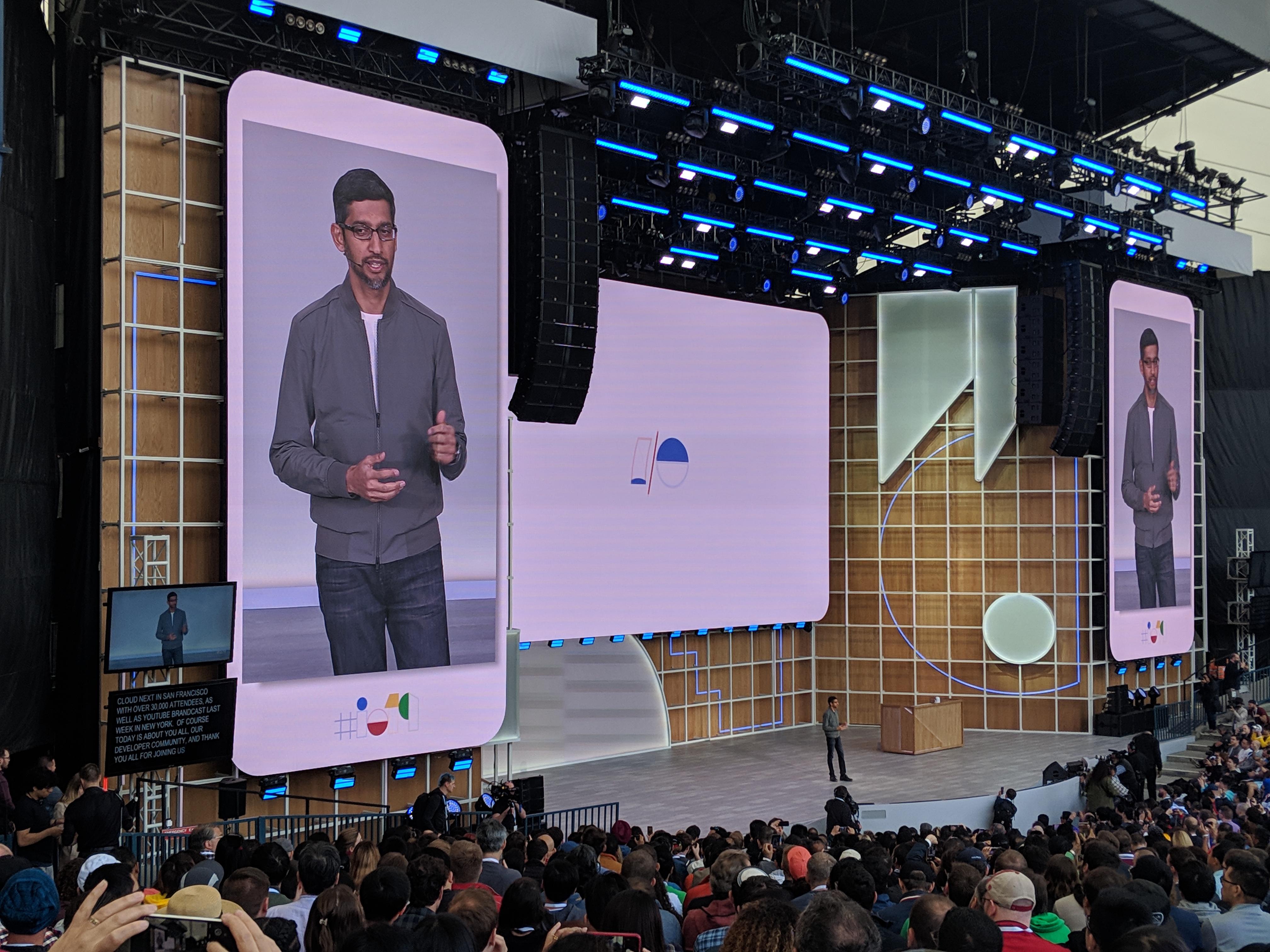

在采用“人工智能第一”战略两年后,首席执行官桑达皮采展示了谷歌如何在其平台上应用人工智能以制造“更有帮助”的谷歌。谷歌首席执行官桑达皮采周二表示,由于人工智能的进步,“我们正在从帮助您找到帮助您完成工作的公司答案的公司转移,”Pichai在他的Google I / O主题演讲中说。“我们希望我们的产品能够在您的工作,家庭和生活中更加努力地为您服务。”

两年前,在年度开发者大会上,Pichai制定了Google的“人工智能第一”战略。周二,他阐述了AI在其所有平台,产品和服务中产生重大影响的方式。

从操作系统和应用程序到家庭设备和车载界面,Google正在向各地注入人工智能。我们的想法是,人工智能将帮助人们在生活的各个方面提高工作效率,无论他们是在公司环境中还是需要帮助阅读地铁上的标志。由于Google智能助理是许多公告的核心,包括下一代双工,因此很明显新的人工智能功能将如何为谷歌的许多产品带来更多价值 - 并有可能帮助谷歌建立其广告销售以外的收入来源。

Pichai通过展示机器学习如何在搜索中启用新功能来开启会议。例如,Google正在将其“全覆盖”新闻功能带到Google搜索,以便更好地在搜索中整理新闻结果。例如,如果用户搜索“黑洞”,机器学习将有助于识别不同类型的故事,并让他们全面了解故事的覆盖方式。

谷歌还在扩展Lens(去年首次推出I / O的人工智能相机工具)的功能,将物理世界中的更多东西与数字信息连接起来。因此,例如,用户可以将他们的支持Lens的设备指向餐馆菜单以提取菜单项的图片。或者他们可以将Lens指向Bon Apetit杂志上的食谱,看看页面还活着。谷歌表示,它正在与零售商和博物馆等合作伙伴合作,以创造这些体验。

为了确保人工智能相机功能真正适用于每个人,谷歌宣布它已将新的文本翻译和语音功能集成到Google Go中,这是用于入门级设备的搜索应用程序。用户可以简单地将应用指向一个标志,让它大声朗读给他们。用户还可以让应用程序翻译文本,然后以他们的首选语言大声朗读。

该功能目前使用十几种语言。它利用了文本到语音,计算机视觉和Google 20年来对搜索的语言理解。压缩到100 KB以上,它可以在价格低至35美元的手机中使用,因此全球超过8亿成年人难以阅读。

人工智能还在推动新的设备上工具 - 其中一些工具旨在改善残疾用户的可访问性。例如,一个名为Live Relay的工具可以帮助聋人使用手机,即使他们不想说话。完全在设备上运行 - 私人会话保留在用户手中 - 直播中继会将来电中的语音转换为文本。然后,它将用户的文本响应转换为语音。它首先提醒线路另一端的人,他们正在与用户的虚拟助手通话。

谷歌还在探索可以理解不同类型语音的个性化通信模型的想法。谷歌研究人员正在收集难以理解的用户的语音样本 - 例如口吃或中风患者 - 培训新的语音识别模型。这项名为Project Euphonia的研究项目将在未来通知Google智能助理语音识别模型。

谷歌还展示了虚拟助手如何为其硬件供电,包括其扩展的智能家居设备系列。谷歌宣布以Nest名称重新命名Google Home家族,并推出Next Hub Max。Next Hub Max专为公共空间设计,如厨房,配有摄像头和更大的10英寸显示屏。谷歌表示,它可以有效地发挥电视,数码相框,智能家居控制器等功能。今年夏天晚些时候推出,售价229美元。